Ist Künstliche Intelligenz Veränderungsmotor oder Manipulator, wird sie Partner werden oder technischer Organismus? In vier Vorträgen aus Informatik und Zukunftsforschung widmete sich die Kortizes-Veranstaltungsreihe "Vom Reiz der Sinne" diesmal dem Schwerpunktthema KI.

In der alljährlichen Nürnberger Vortragsreihe "Vom Reiz der Sinne", die das Institut für populärwissenschaftlichen Diskurs Kortizes von Mitte März bis Anfang April 2019 in Kooperation mit dem Planetarium Nürnberg und den Nürnberger Nachrichten (NN) anbot, ging es diesmal um den aktuellen Stand der KI-Forschung und die mit dem Feld verbundenen Hoffnungen und Ängste.

KI als Veränderungsmotor

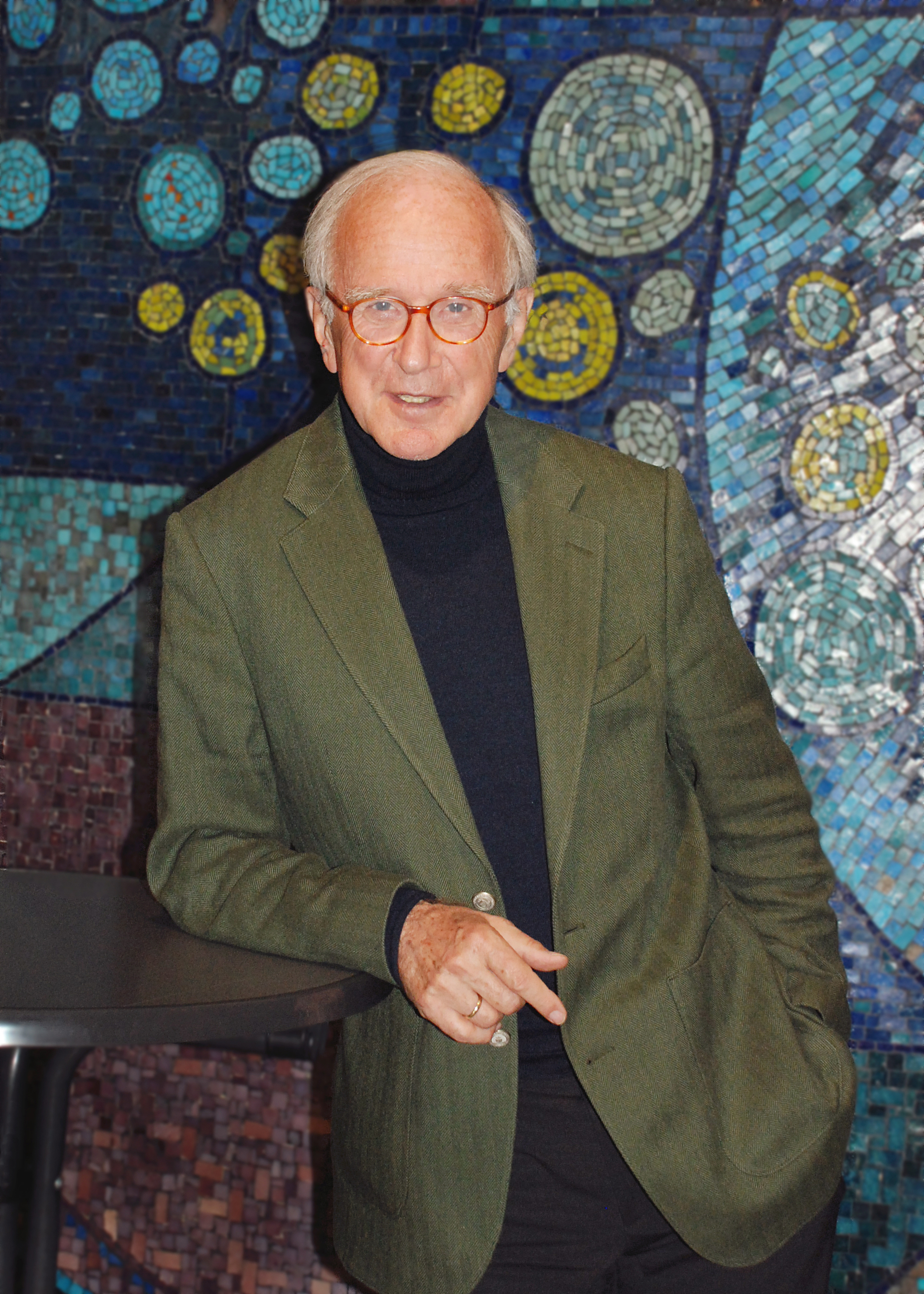

Zum Auftakt der Reihe am 12. März 2019 führte der NN-Journalist Daniel Hertwig ein Gespräch mit dem Zukunftsforscher Dr. Bernd Flessner von der Universität Erlangen-Nürnberg, der das Publikum dabei bat, keine Vorhersagen zu erwarten. Seriöse Zukunftsforschung könne nur über Wahrscheinlichkeiten reden. "Die Zukunft ist offen und Zufälle spielen eine große Rolle", erklärte er.

Als Zukunftsforscher entwerfe er Szenarien wie das einer smarten Technologiesphäre, in der wir in 20 Jahren leben könnten, erklärte Flessner. In diesem Szenario können wir ein Kleid, das uns im Film gefällt, mit Hilfe von Digital Fabricators (oder kurz: Fabber) zu Hause einfach ausdrucken. Und wir sind umgeben von vernetzten Geräten, die auch Entscheidungen und Handlungen für uns übernehmen.

Weil es aber oft nicht die primären Erfindungen sind, die die größten sozialen Änderungen bringen, sondern die sekundären und tertiären, untersucht Flessner, wie sich auf der Grundlage dieser technischen Innovation unsere Gesellschaft verändern könnte. "Werden Menschen ihre persönlichen Roboter heiraten können?" Für wenig berechtigt hält Flessner aber eine der größten Sorgen, die Menschen in Bezug auf KI haben: den drohenden Verlust von Arbeitsplätzen. "In meinem Szenario werden nicht alle arbeitslos. Nach einem Automatisierungsschub werden zwar einfache, repetitive Tätigkeiten wegfallen, aber dafür neue entstehen." So sei es in der Vergangenheit bei Automatisierungen stets gewesen.

Flessner beobachtet, dass die Gesellschaft in Bezug auf KI gleichzeitig zu pessimistisch und zu optimistisch ist. Unbedingt gesellschaftlich stärker diskutiert werden sollte seiner Ansicht nach, wie wir mit immer leistungsfähiger werdenden bewaffneten Drohnen umgehen wollen, die zu autonom agierenden Killerrobotern werden könnten. Hier bereite sich die Gesellschaft zu wenig auf kommende Änderungen vor. "Deutschland hat noch nicht entschieden, ob es so etwas verbieten will."

KI als Manipulator

Auch beim darauffolgenden Vortrag von Professor Dr. Marc Stamminger am 19. März 2019 ging es um Konsequenzen eines technischen Fortschritts, auf die wir uns gesellschaftlich einstellen müssen. Denn der Erlanger Informatik-Professor im Bereich Graphische Datenverarbeitung zeigte, dass Videos heute schon ebenso überzeugend manipuliert werden können wie Fotos.

Stammingers Arbeitsgruppe selbst hatte 2016 mit anderen Forschern zusammen eine Methode vorgestellt, mit der die Mimik von Personen in Live-Videos verändert werden kann. Ein Youtube-Video, in dem sie ihre Forschungsergebnisse zu dem sogenannten "Facial Reenactment" an Aufnahmen bekannter Politiker demonstrierten, verbreitete sich damals viral und wurde seitdem 4,5 Millionen Mal angesehen. In über 2.000 Kommentaren unter dem Video äußern Menschen neben Bewunderung auch viel Erschrecken und Beunruhigung.

In den vier Jahren seitdem hat sich die Entwicklung noch beschleunigt. Denn zu klassisch programmierten Methoden wie denen von Stamminger sind KI-getriebene Techniken hinzugekommen, die sogenannte Deep Fakes erzeugen können. Für ihre Produktion werden neuronale Netze trainiert, Videos aus verschiedenen Quellen zu neuen, täuschend echten Videos zu verschmelzen. Bekannt wurde das Potenzial dieser Technik 2017 durch Berichte über den Tausch von Pornofilmen im Internet, bei denen die Gesichter der Darstellerinnen durch die Gesichter bekannter Hollywood-Schauspielerinnen ersetzt wurden.

Dass Fotos manipuliert sein können, weiß jeder. Stamminger betonte in seinem Vortrag, dass es heute nun ebenso wichtig sei sich klarzumachen, dass auch Videos nicht immer vertrauenswürdig sind. Doch wir seien der Entwicklung nicht hilflos ausgeliefert. Es gebe eine ebenso rasant fortschreitende Forschung zur Aufdeckung sowohl von Bild- wie auch von Video-Manipulationen. Wer weiß, worauf zu achten ist, kann auch Deep Fakes als manipuliert erkennen – etwa durch fehlende Details bei den Zähnen oder fehlende Reflexionen in den Augen.

KI als Partner

Die Referentin des nächsten Termins, die Bamberger KI-Professorin Dr. Ute Schmid, stellte am 26. März 2019 ihre Vision interaktiver KI-Systeme vor, die als Partner von Menschen fungieren. Zuvor gab sie einen Einblick in Geschichte und Konzepte der KI-Forschung. So erinnerte sie daran, dass das Feld seit der Prägung des Begriffs "Künstliche Intelligenz" schon mehrere "Winter" durchgemacht hat. Durch überzogene Erwartungen und Fehlschläge habe es seit 1956 drei Phasen gegeben, in denen sich kaum noch jemand als KI-Forscher bezeichnete.

Auch dem momentanen Hype könnte wieder ein solcher "Winter" folgen, meint Schmid, weil menschliche Erwartungen weiterhin enttäuscht würden. So schrieben wir Personen, die gut Mathe und Schachspielen könnten, Intelligenz zu. Wenn Menschen in diesen Bereichen durch Maschinen geschlagen würden, nähmen wir an, diese Maschinen würden uns auch in allen anderen Bereichen überlegen sein. Doch dem sei nicht so. Witze verstehen, Fahrrad fahren und empathisch sein, könnten Menschen immer noch besser. Aber diese Fähigkeiten gälten nicht als Zeichen besonderer Intelligenz.

Auch die Annahme, maschinelles Lernen könne fehlerfreie Ergebnisse liefern, sorge für Enttäuschungen. Denn sowohl maschinelles wie menschliches Lernen könne als induktiver Prozess, der Erfahrungen generalisiere, kein gesichertes Wissen erzeugen und nicht fehlerfrei sein. Auch ein gewisser Bias sei unvermeidlich. Für Schmid heißt das: Vertrauen in lernende Maschinen sollte auf Transparenz und Nachvollziehbarkeit gründen. Sprich: KI-Systeme müssen Menschen ihre gelernten Hypothesen vermitteln können.

Dafür brauche es einen dritten Weg zwischen Assistenzsystemen und autonomen KI-Systemen. Für Schmid liegt die Entscheidung idealerweise weder allein beim Menschen noch allein bei der Maschine. Vielmehr sollte ein Austausch zwischen beiden angestrebt werden, bei dem die Maschine dem Menschen erklärt, worauf ihre Einschätzung beruht. Das erfordere jedoch, dass maschinelles Lernen nicht in der Black Box stattfinde, sondern den eigenen Lernprozess menschenverständlich dokumentiere.

KI als technischer Organismus

Zum Abschluss der Reihe am 2. April 2019 besprach der Informatiker und Neurobiologe Professor Dr. Christoph von der Malsburg die Entwicklung menschengemachter, technischer Organismen als Ziel der KI-Forschung. Lebewesen könnten nur deshalb autonom agieren, weil sie ein eigenes emotionales Antriebssystem hätten. Damit KI-Systeme eigenständig Aufgaben erfüllen, bräuchten daher auch sie ein solches Antriebssystem, so seine Argumentation.

Die Vision eines selbstfahrenden Autos erschöpft sich für den Referenten nicht darin, dass ein Nutzer dem Fahrzeug das Ziel vorgibt und dieses ihn dann von A nach B bringt. Von der Malsburg wünscht sich ein KI-System mit viel weitergehenderen Kompetenzen. Er möchte zu ihm sagen können: Hol den Einkauf und dann die Tochter ab. Und das System soll alle möglicherweise auftauchenden Probleme auf dem Weg selbstständig lösen können.

Dieses wesentlich ehrgeizigere Ziel ist nach von der Malsburgs Meinung unerreichbar mit den heutigen Konzepten. Denn trotz aller aktuellen Erfolge von KI würden heutige Systeme nichts verstehen, nichts fühlen und nichts machen können, was der Mensch ihnen nicht vorgemacht habe. Eigene Emotionen und ein Verständnis von Bedeutungen wären die Voraussetzung für echte Autonomie.

KI wird komplexe Aufgaben aus von der Malsburgs Sicht erst dann selbstständig lösen können, wenn wir den Systemen Bewusstsein und generelle Intelligenz geben. "Es gibt jedoch keinen Konsens, was uns daran hindert, Fortschritte dahin zu erreichen." Aus seiner Sicht gilt es beim Verständnis dieser Eigenschaften vor allem, den neuronalen Grundlagen von Phänomenen der Emergenz, Selbstorganisation und Gestalterkennung auf den Grund zu gehen.

Auch die nächsten Termine von Kortizes sind Kooperationsveranstaltungen. So ist das Institut gemeinsam mit dem bfg Fürth und dem bfg Erlangen Partner der Buchpräsentation von Dr. Kristina Hänel, die am 19. Mai 2019 im Rahmen der Säkularen Buskampagne der Giordano-Bruno-Stiftung im Nürnberger Marmorsaal stattfindet: "Das Politische ist persönlich! Tagebuch der "Abtreibungsärztin", die sich nicht mundtot machen lässt.

Daran schließt sich ab 21. Mai die Lesereihe "Freier Geist in Fürth" an. Im Nürnberger Planetarium geht's am 25. Juni weiter mit der abschließenden Reihe "Vom Reiz des Übersinnlichen" mit vier kritischen Vorträgen über Verschwörungstheorien.

5 Kommentare

Kommentare

Bernd Kammermeier am Permanenter Link

Völlig unabhängig davon, ob jemals echte KI-Systeme entwickelt werden können, ist bereits jetzt mehr als deutlich geworden, dass der "echte" Mensch im gleichen Maße Fähigkeiten verliert, in denen er "Er

Das ist auch völlig logisch, da wir von Natur aus daraufhin angelegt sind, alles Überflüssige einzustellen, weil Überflüssiges sinnlos Energie verbraucht. Wenn ich also nicht mehr den Weg wissen muss, weil ich ein Navi habe, dann vergesse ich diesen Weg und bin im Fall des Versagens des Navis orientierungslos. Ich kenne Beispiele dafür aus dem Bekanntenkreis. Etc. pp.

Vor dem Digital-Hype waren Erfindungen Erweiterungen menschlicher Fähigkeiten. Sie unterstützten also Menschen in vielen Bereichen des Lebens. Doch zunehmend - vor allem bei der Idee der KI - ersetzen Maschinen den Menschen auf fundamentale Weise. Die "natürlichen" Fähigkeiten schrumpfen entsprechend, wie die Fähigkeit zum Laufen bei einem Bettlägerigen abnimmt.

Natürlich mögen manche davon träumen, vor einem KI-Partner durchs Leben geführt zu werden, der einem alles abnimmt. Dieses Leben wäre wesentlich angenehmer, weil man sich in der Extremform um überhaupt nichts mehr kümmern muss, außer um Atmen, Essen, Trinken und Ausscheiden. Wissensaneignung ist überflüssig, weil kein menschliches Gehirn jemals so viel speichern und blitzschnell abrufen kann wie ein Computer. Kein Mensch kann je so sicher Autofahren wie ein autonom fahrendes Auto.

Die nächste logische Frage ist: Warum braucht es dann noch den störanfälligen, langsamen und vergleichsweise unwissenden Menschen? Es bleibt nur die Hoffnung - da die Entwicklung der KI sicher nicht mehr aufzuhalten ist -, dass diese Frage nie von den Maschinen gestellt wird...

Hans Trutnau am Permanenter Link

"... erst dann selbstständig lösen können, wenn wir den Systemen Bewusstsein und generelle Intelligenz geben." Manche träumen gar davon, die eigenen Gedanken, Informationen, Emotionen etc.

Kay Krause am Permanenter Link

Wenn man die technische Entwicklung seit Beginn der Industriealisierung vor dem geistigen Auge ablaufen läßt, und dazu diesen interessanten Artikel aufmerksam gelesen hat, kann man wohl (wie ich) zu dem Schluß kommen,

Peder Iblher am Permanenter Link

Danke für diese übersichtliche Zusammenfassung. Erhellend fand ich einmal den Satz, dass KI-Anwendungenn so lange KI genannt werden, bis es einen eigenen Namen dafür gibt. Dann heißen sie Kaffeemaschine oder so.

Bernd Kammermeier am Permanenter Link

" Abnehmende menschliche Fähigkeiten? Ja, aber. Es sieht nicht danach aus, dass wir lesen und schreiben verlernen oder Kartenlesen oder gehen, im Gegenteil."

Warum im Gegenteil? Früher war Handschrift wichtig. Heute ist Handschrift unwichtig. Wir tippen. Grammatik, Rechtschreibung, alles unwichtig. Autokorrekturprogramme schalten sich ein, Autovervollständigung. Oder es ist völlig egal, Hauptsache es ist irgendwie verständlich. Trump regiert so ein riesiges Land.

Sprachsteuerungen halten gerade Einzug. Wozu überhaupt noch schreiben? Und viele Systeme denken bereits für uns. Heißt es eines Tages: Wozu noch denken? Doch! Wir verlieren Fähigkeiten, weil wir akzeptablen Ersatz bekommen. Weil es bequem macht. Wir fahren SUV, weil es bequemer ist - und zerstören mit diesen Dreckschleudern die Umwelt.

"Solange tatsächlich auf die Bedürfnisse der Menschen Rücksicht genommen wird (und daran gearbeitet, diese zu formulieren) sind wir auf einem guten Weg."

Wer nimmt darauf Rücksicht? Die Maschinen? Ein schöner Traum...